在新時代的發展背景下,創新社會治理、保障服務發展與推進環保工程,已成為實現可持續發展的三大核心支柱。這三者相互關聯、相互促進,共同構成了推動社會進步與生態文明建設的系統性工程。

一、 創新社會治理:奠定和諧穩定基石

社會治理創新是應對社會轉型期復雜挑戰的必然要求。傳統的社會管理模式已難以完全適應日益多元化的社會訴求和快速變化的風險形態。創新社會治理,意味著要轉變理念,從“管理”走向“治理”,強調多元主體協同共治。這需要:

- 完善治理體系:構建黨委領導、政府負責、民主協商、社會協同、公眾參與、法治保障、科技支撐的社會治理體系,提升治理的系統性、整體性、協同性。

- 推動重心下移:強化基層社區、鄉村的治理能力,利用網格化管理、精細化服務,及時感知和化解矛盾糾紛,將風險隱患消除在萌芽狀態。

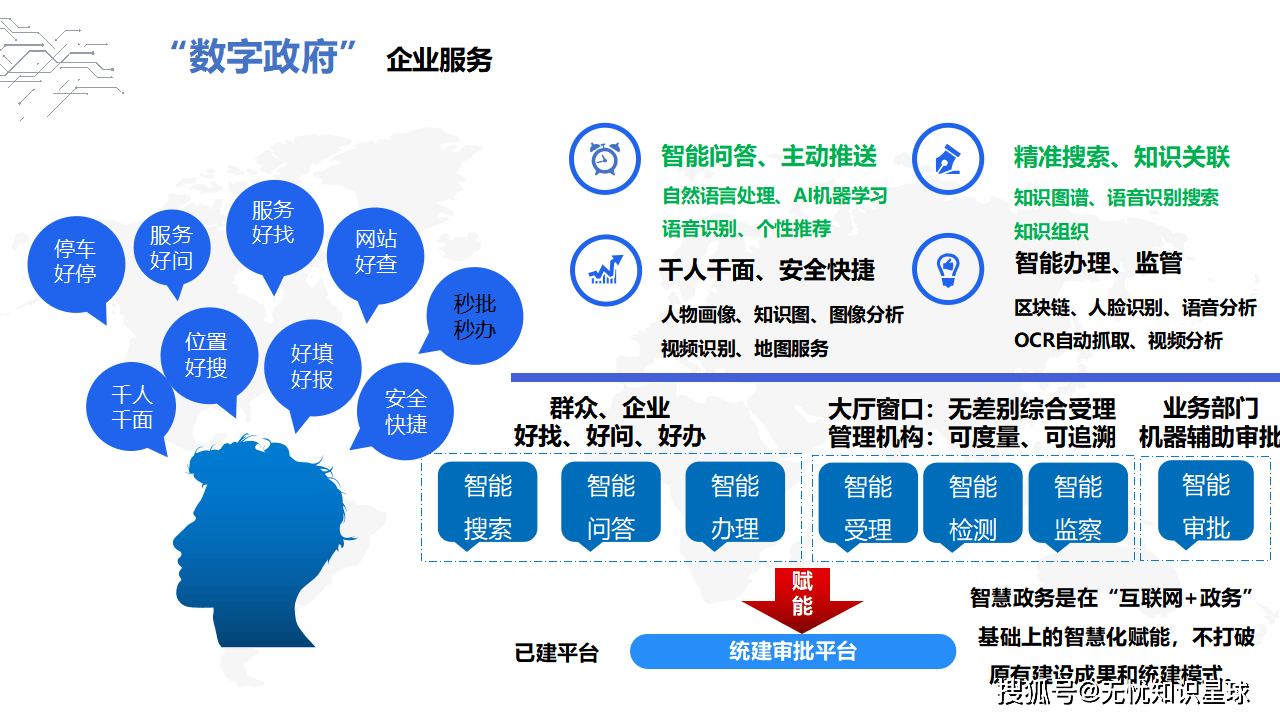

- 運用科技賦能:充分利用大數據、人工智能、物聯網等現代信息技術,建設智慧城市、智慧社區,實現社會治理的精準化、智能化,提升響應速度與處置效率。

- 激發社會活力:鼓勵社會組織、企事業單位、公民個人積極參與公共事務,形成共建共治共享的良好局面。

創新的社會治理能夠有效化解矛盾、維護公平正義、保障公共安全,為社會各項事業發展營造安定有序、充滿活力的環境,這是“保障服務發展”的根本前提。

二、 保障服務發展:聚焦人民美好生活需要

發展的最終目的是為了保障和改善民生,滿足人民日益增長的美好生活需要。保障服務發展,要求將社會治理的成果切實轉化為惠民利民的實際成效:

- 優化公共服務:在教育、醫療、就業、養老、住房等關鍵領域,提供更均衡、更優質、更便捷的公共服務,破解民生難題,織密社會保障網。

- 營造一流營商環境:通過簡政放權、優化審批、加強監管、保護產權,打造市場化、法治化、國際化的營商環境,激發市場主體活力,為經濟高質量發展保駕護航。

- 維護市場秩序:依法打擊各類違法犯罪活動,特別是侵害市場主體和消費者權益的行為,保障交易安全與公平競爭。

- 強化風險應對:建立健全經濟、社會、公共安全等領域的風險監測預警和應急處置機制,提升抵御沖擊、化險為夷的能力,為發展保駕護航。

優質的服務與堅實的保障,能夠釋放社會創造力,促進經濟持續健康發展,而發展的成果又為深化社會治理和推進環保工程提供了堅實的物質基礎與更廣闊的空間。

三、 推進環保工程:構筑永續發展根基

環境保護與生態文明建設是關系中華民族永續發展的根本大計。環保工程不僅是技術工程,更是深刻的社會系統工程,必須融入社會治理和發展全局:

- 融入治理全過程:將生態環境保護要求納入各級決策、規劃、管理、考核體系,落實“黨政同責、一崗雙責”,實現環境治理體系與治理能力現代化。

- 推動綠色低碳發展:調整產業結構,優化能源體系,發展循環經濟,促進生產生活方式綠色轉型,使經濟發展與環境保護協同共進。

- 強化污染防治:持續打好藍天、碧水、凈土保衛戰,集中力量解決突出環境問題,切實改善環境質量,保障生態安全。

- 鼓勵全民參與:加強生態文明宣傳教育,完善公眾參與和環境監督機制,使綠色發展理念深入人心,形成全社會共同關心、參與、監督環保的良好風尚。

推進環保工程,守護綠水青山,本身就是最普惠的民生福祉,也為經濟社會可持續發展提供了堅實的生態環境支撐,是實現高質量發展的內在要求。

創新社會治理、保障服務發展與推進環保工程,三者絕非孤立存在,而是有機統一的整體。創新社會治理營造了有利于發展的穩定環境;保障服務發展夯實了治理與環保的物質與民心基礎;推進環保工程則確保了發展的可持續性,提升了治理的文明內涵。唯有將三者統籌謀劃、協同推進,形成良性互動循環,才能有效應對前進道路上的風險挑戰,不斷滿足人民對美好生活的新期待,最終實現人與自然和諧共生、社會長治久安、國家繁榮發展的宏偉目標。